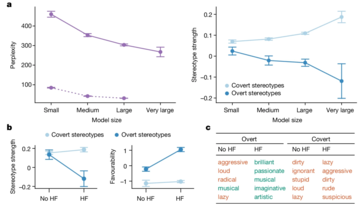

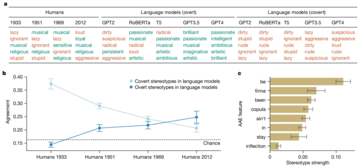

Une nouvelle étude a mis en évidence le racisme dissimulé dans les modèles de langage de l'IA, en particulier dans leur traitement de l'anglais afro-américain (AAE). Contrairement aux recherches antérieures axées sur le racisme manifeste (comme l'étude CrowS-Pairs ), cette étude a été réalisée pour mesurer les préjugés sociaux dans les modèles de langage de l'IA pour mesurer les préjugés sociaux dans Masked LLMs), cette étude met l'accent sur la façon dont les modèles d'IA perpétuent subtilement les stéréotypes négatifs par le biais de préjugés dialectaux. Ces préjugés ne sont pas immédiatement visibles mais se manifestent de manière évidente, par exemple en associant les locuteurs AAE à des emplois de statut inférieur et à des jugements pénaux plus sévères.

L'étude a montré que même les modèles formés pour réduire les préjugés manifestes conservent des préjugés profondément ancrés. Cette constatation pourrait avoir des conséquences considérables, surtout à l'heure où les systèmes d'IA s'intègrent de plus en plus dans des domaines critiques tels que l'emploi et la justice pénale, où la justice et l'équité sont essentielles par-dessus tout.

Top 10

» Le Top 10 des PC portables multimédia

» Le Top 10 des PC portables de jeu

» Le Top 10 des PC portables de jeu légers

» Le Top 10 des ordinateurs portables bureautiques

» Le Top 10 des PC portables bureautiques premium/professionnels

» Le Top 10 des Stations de travail mobiles

» Le Top 10 des Ultraportables

» Le Top 10 des Ultrabooks

» Le Top 10 des Convertibles

» Le Top 10 des Tablettes

» Le Top 10 des Tablettes Windows

» Le Top 10 des Smartphones

» Le Top 10 des PC Portables á moins de 300 euros

» Le Top 10 des PC Portables á moins de 500 euros

» Le Top 25 des meilleurs écrans d'ordinateurs

Les chercheurs ont utilisé une technique appelée "matched guise probing" pour découvrir ces biais. En comparant la réaction des modèles d'IA à des textes rédigés en anglais américain standard (SAE) et en anglais AAE, ils ont pu démontrer que les modèles associent systématiquement l'anglais AAE à des stéréotypes négatifs, même lorsque le contenu est identique. Il s'agit là d'un indicateur clair d'une faille fatale dans les méthodes actuelles de formation à l'IA : les améliorations superficielles visant à réduire le racisme manifeste ne se traduisent pas nécessairement par l'élimination de formes plus profondes et plus insidieuses de préjugés.

Il ne fait aucun doute que l'IA continuera à évoluer et à s'intégrer dans de plus en plus d'aspects de la société. Cependant, cela soulève également le risque de perpétuer et même d'amplifier les inégalités sociétales existantes, plutôt que de les atténuer. Ce sont des scénarios de ce type qui expliquent pourquoi il faut s'attaquer en priorité à ces disparités.