Les ingénieurs du Stanford Computational Imaging Lab ont mis au point un prototype de lunettes AR légères, ouvrant la voie à de futures lunettes AR holographiques nettement plus légères que les casques actuellement disponibles. La clé de cette innovation réside dans un écran piloté par l'IA qui projette une image en 3D sans utiliser de lentilles encombrantes, grâce à deux métasurfaces situées dans un fin guide d'ondes optiques.

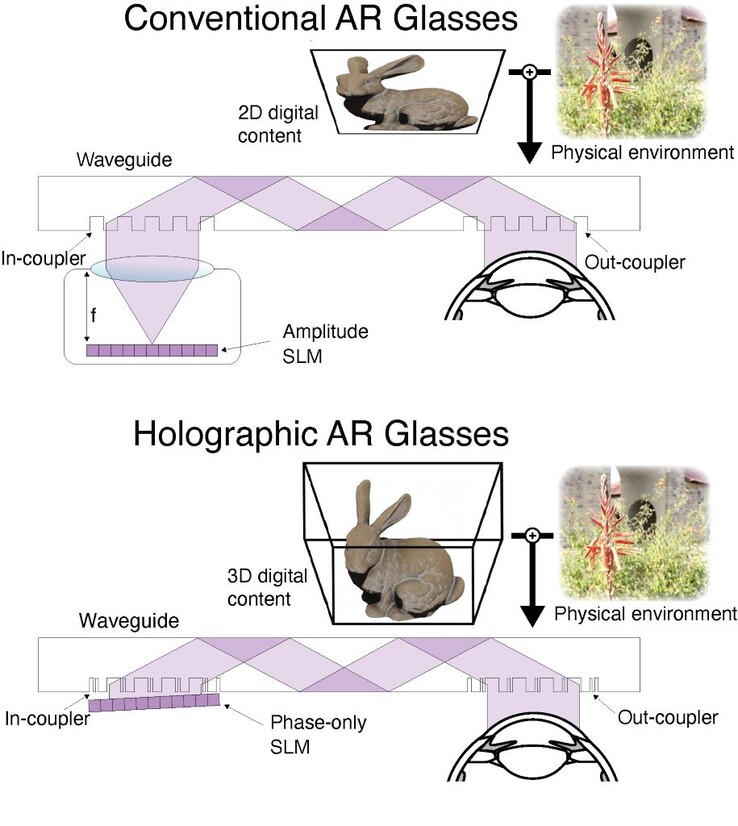

Les casques AR/VR/XR conventionnels utilisent généralement des lentilles de focalisation pour projeter des images de micro LED ou OLED dans les yeux de l'utilisateur. Malheureusement, la profondeur requise pour les lentilles conduit à des conceptions encombrantes, telles que les smartphones dans Google Cardboard ou le casque Apple Vision Pro qui pèsent plus de 600 grammes.

Les modèles plus minces utilisent parfois un guide d'ondes optiques (pensez-y comme un périscope) pour déplacer l'écran et les lentilles de l'avant des yeux vers le côté de la tête, mais ils limitent l'utilisateur à des images et du texte en 2D. Les ingénieurs de Stanford ont combiné la technologie de l'intelligence artificielle et les guides d'ondes à métasurface pour réduire le poids et l'encombrement de leur casque de réalité augmentée tout en projetant une image holographique en 3D.

La première innovation consiste à éliminer les lentilles de mise au point encombrantes. À la place, des métasurfaces ultrafines gravées dans le guide d'ondes "codent", puis "décodent" une image projetée en courbant et en alignant la lumière. En gros, c'est comme si vous éclaboussiez l'eau à une extrémité d'une piscine selon un rythme déterminé et que, lorsque les vagues atteignent l'autre extrémité, vous puissiez les lire pour recréer le rythme d'origine. Les lunettes Stanford utilisent une métasurface devant l'écran et une autre devant l'œil.

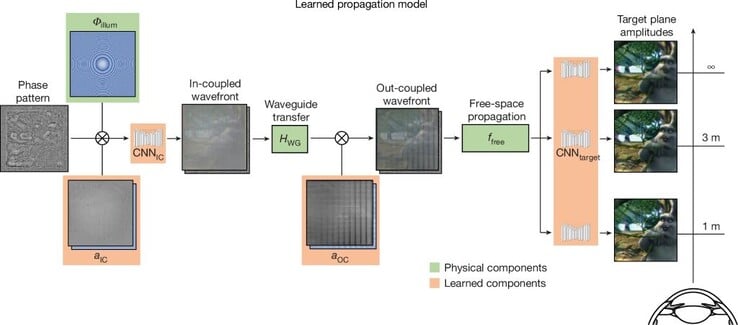

La seconde est un modèle de propagation de guide d'ondes qui simule la façon dont la lumière rebondit à travers le guide d'ondes pour créer des images holographiques avec précision. les holographies 3D dépendent fortement de la précision de la transmission de la lumière, et même des variations de l'ordre du nanomètre dans les surfaces du guide d'ondes peuvent modifier considérablement l'image holographique observée. Ici, des réseaux neuronaux à convolution à apprentissage profond utilisant une architecture UNet modifiée sont entraînés sur la lumière rouge, verte et bleue envoyée à travers le guide d'ondes pour compenser les aberrations optiques du système. En gros, imaginez que vous tirez une flèche dans l'œil du taureau, mais qu'elle touche un tout petit peu à droite - vous savez maintenant qu'il faut compenser en visant un tout petit peu à gauche.

La troisième est l'utilisation d'un réseau neuronal d'IA pour créer des images holographiques. UN ORDINATEUR DE 48 GO Nvidia RTX A6000 a été utilisée pour entraîner l'IA sur une large gamme de modèles de phase projetés par le module d'affichage SLM à phase unique Holoeye Leto-3 de https://holoeye.com/products/spatial-light-modulators/leto-3-phase-only/ module d'affichage SLM à phase unique. Au fil du temps, l'IA a appris quels motifs pouvaient créer des images spécifiques à quatre distances (1 m, 1,5 m, 3 m et l'infini).

Dans l'ensemble, le modèle d'IA qui alimente ce casque produit des images 3D nettement meilleures que les autres solutions. Bien que les lunettes AR de Stanford soient un prototype, les lecteurs peuvent toujours profiter du monde augmenté aujourd'hui avec un casque léger comme celui-ci sur Amazon.

Source(s)

Top 10

» Le Top 10 des PC portables multimédia

» Le Top 10 des PC portables de jeu

» Le Top 10 des PC portables de jeu légers

» Le Top 10 des ordinateurs portables bureautiques

» Le Top 10 des PC portables bureautiques premium/professionnels

» Le Top 10 des Stations de travail mobiles

» Le Top 10 des Ultraportables

» Le Top 10 des Ultrabooks

» Le Top 10 des Convertibles

» Le Top 10 des Tablettes

» Le Top 10 des Tablettes Windows

» Le Top 10 des Smartphones

» Le Top 10 des PC Portables á moins de 300 euros

» Le Top 10 des PC Portables á moins de 500 euros

» Le Top 25 des meilleurs écrans d'ordinateurs